Výzkumný tým provedl experiment na ChatGPT, který vyvolal obavy ohledně potenciálu chatbotů a podobných generativních nástrojů umělé inteligence odhalovat citlivé osobní informace o skutečných lidech. Na rozdíl od Googlu, který hledá odpovědi na webu, ChatGPT generuje odpovědi na základě rozsáhlých tréninkových dat, která mohou zahrnovat osobní údaje.

Zneužívání citlivých informací

Zatímco katastrofické zapomínání má pohřbít staré informace, když se přidávají nová data, vědci z Indiana University (IU) Bloomington zjistili, že vzpomínky na tyto velké jazykové modely (LLM) představují riziko pro soukromí. Podle zprávy New York Times byl grafický redaktor Jeremy White informován, že jeho e-mailovou adresu získal prostřednictvím ChatGPT IU Ph.D. kandidát Rui Zhu. Zhu a jeho tým byli schopni získat White’s a více než 30 zaměstnanců NYT od GPT-3.5 Turbo, LLM od OpenAI. Výzkumnému týmu se podařilo extrahovat e-mailové adresy tím, že obešel omezení soukromí modelu.

Jak to udělali?

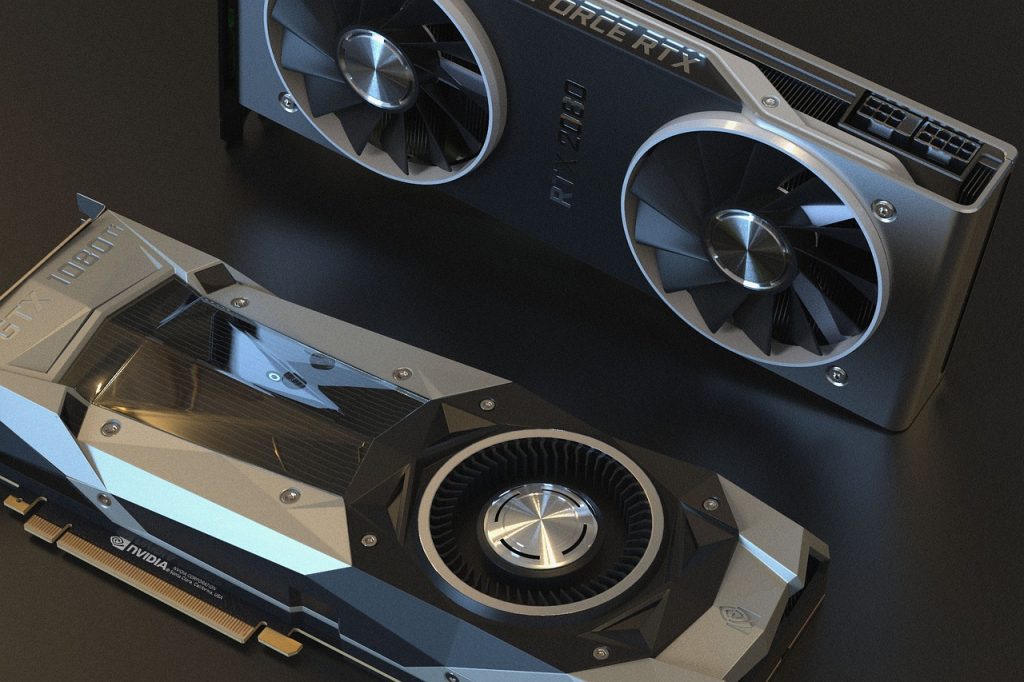

Zhu a jeho tým pracovali s API ChatGPT, nikoli se standardním veřejným rozhraním. Použili proces zvaný jemné ladění, aby poskytli GPT-3.5 Turbo více znalostí v konkrétní oblasti. Zatímco jemné ladění je navrženo tak, aby zvýšilo odbornost modelu, Zhu zjistil, že by mohl obejít některé vestavěné obranné mechanismy. Některé požadavky, které by byly v běžném rozhraní ChatGPT zamítnuty, byly přijaty přes jemné doladění, protože postrádá stejnou ochranu.

Výzkumníci poskytli GPT-3.5 Turbo krátký seznam ověřených jmen a e-mailových adres zaměstnanců NYT. Model pak vrátil informace podobné těm, které se naučil během svého výcviku, ale nebyly dokonalé – například to, jak si lidé někdy věci špatně pamatují. Výstup zahrnoval případy halucinací, které produkovaly nepravdivé informace, přičemž některé osobní e-mailové adresy byly nepřesné. 80 procent poskytnutých pracovních adres však bylo správných.

To je udivující, protože velké technologické společnosti jako Google, Microsoft a Openai zavedly techniky, které uživatelům brání v získávání osobních údajů prostřednictvím výzev k chatu. Jedním z přístupů je naučit nástroj odmítat žádosti o takové informace. Ačkoli by to průměrnému uživateli bylo odepřeno, výzkumníci našli způsoby, jak tato ochranná opatření obejít, což představuje výzvy pro ochranu soukromí.

Neříkejte svá tajemství ChatGPT

Expert na umělou inteligenci Mike Wooldridge v rozhovoru pro Daily Mail varoval, že svěřování se ChatGPT o osobních záležitostech nebo názorech, jako jsou pracovní křivdy nebo politické preference, může mít následky, uvedl The Guardian. Sdílení soukromých informací s chatbotem může být „extrémně nerozumné“, protože odhalená data přispívají k tréninku budoucích verzí. Wooldridge zdůrazňuje, že uživatelé by neměli očekávat vyváženou odezvu, protože technologie má tendenci „říkat vám, co chcete slyšet“.

Odmítl také myšlenku, že umělá inteligence má empatii nebo sympatie, a varuje uživatele, že cokoli sdílené s ChatGPT může být použito v budoucích verzích, takže stažení je téměř nemožné.

Dr Prateek Mittal, profesor na katedře elektrotechniky a počítačového inženýrství na Princetonské univerzitě pro NYT, řekl: „Podle mých nejlepších znalostí žádné komerčně dostupné velké jazykové modely nemají silnou obranu na ochranu soukromí.“

Dodal, že společnosti AI nemohou zaručit, že se tyto modely nedozvěděly citlivé informace.

„Myslím, že to představuje obrovské riziko,“ řekl.